Leis da Robótica de Asimov precisam de atualização para IA

Redação do Site Inovação Tecnológica - 21/01/2025

[Imagem: Foto:Dariusz Jemielniak/Robô gerado por IA]

Leis da Robótica de Asimov

O progresso da robótica tem feito com que os pesquisadores preocupem-se em atualizar as três leis da robótica, idealizadas pelo autor de ficção científica Isaac Asimov conforme ele escrevia sobre o controle das máquinas inteligentes que vislumbrava para o futuro.

As três leis da robótica propostas por Asimov são:

- Um robô não pode ferir um ser humano ou, através da inação, permitir que um ser humano venha a ser ferido.

- Um robô deve obedecer as ordens que lhe são dadas pelos seres humanos, exceto quando tais ordens entrarem em conflito com a primeira lei.

- Um robô deve proteger sua própria existência desde que essa proteção não entre em conflito com a primeira ou a segunda leis.

Mas o progresso impressionante da Inteligência Artificial pode significar que apenas três leis não serão suficientes para controlar a inteligência das máquinas, sejam elas incorporadas em robôs ou não.

Esta é a opinião do professor Dariusz Jemielniak, da Universidade Kozminski, na Polônia.

"Hoje, estamos entrando em uma era de colaboração sem precedentes entre humanos e IA que Asimov dificilmente poderia ter previsto. O rápido avanço das capacidades generativas de IA, particularmente na geração de linguagem e imagem, criou desafios além das preocupações originais de Asimov sobre danos físicos e obediência," justifica Jemielniak.

[Imagem: CC0 Creative Commons]

Falsidade profunda

A principal preocupação do pesquisador, que chama os sistemas de IA atuais, como ChatGPT e Gemini, de "robôs virtuais", envolve o uso desses sistemas para enganar os humanos, o que envolve desde golpes e mentiras comuns até notícias falsas, desinformação e "enganação profunda", superfalsificações com um nível de realismo e sofisticação que exigem conhecimentos técnicos para discernir quando a imagem ou voz de uma pessoa está sendo manipulada.

"A desinformação nas mídias sociais está se espalhando como um incêndio. Estudei isso extensivamente durante a pandemia e só posso dizer que a proliferação de ferramentas de IA generativas tornou sua detecção cada vez mais difícil. Para piorar a situação, artigos gerados por IA são muito persuasivos, ou até mais persuasivos do que a propaganda tradicional, e usar IA para criar conteúdo convincente requer muito pouco esforço," descreveu Kozminski.

Combater isso não é algo que se faça com uma receita única, exigindo abordagens múltiplas, dinâmicas e constantemente atualizadas, para enfrentar os novos mecanismos de enganação que os humanos mal-intencionados certamente idealizarão. Por isso, o pesquisador sugere uma lei geral, que ele coloca como a "Quarta Lei da Robótica".

- Um robô ou IA não deve enganar um humano se passando por um ser humano.

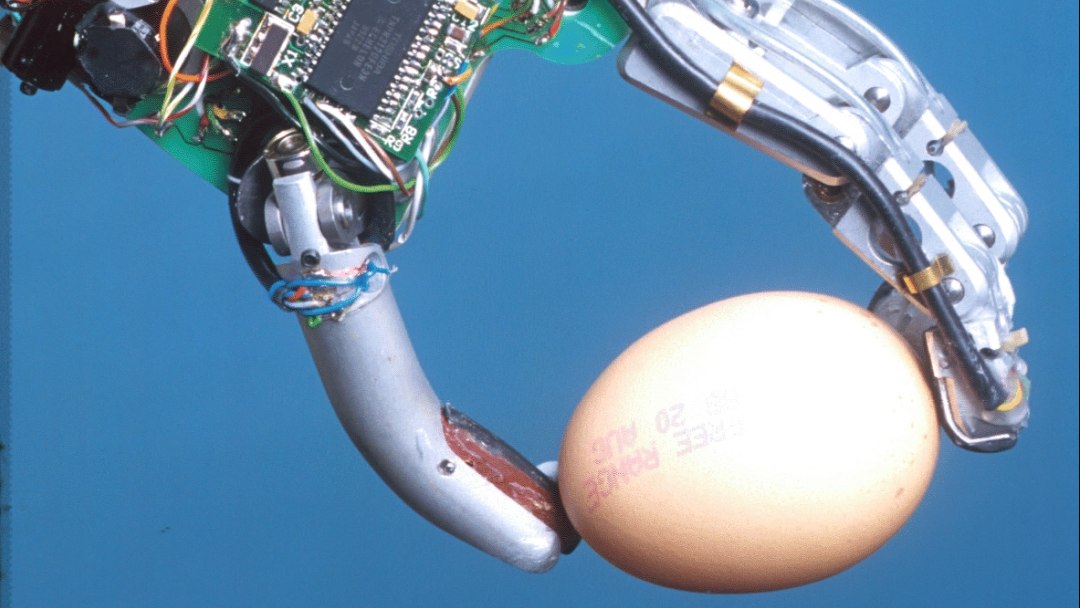

[Imagem: Kevin Warwick]

Rumo a uma IA confiável

Um dos principais mecanismos propostos pelo pesquisador consiste em deixar claro quando algo - texto, vídeo, voz etc - foi criado ou editado por sistemas de IA.

"Precisamos de limites claros. Embora a colaboração entre humanos e IA possa ser construtiva, o engano da IA enfraquece a confiança e leva à perda de tempo, sofrimento emocional e uso indevido de recursos. Os agentes artificiais devem se identificar para garantir que nossas interações com eles sejam transparentes e produtivas. O conteúdo gerado pela IA deve ser claramente marcado, a menos que tenha sido significativamente editado e adaptado por um humano," propõe Kozminski.

Para ele, a implementação da Quarta Lei da Robótica exigirá:

- Anúncio obrigatório da IA em interações diretas.

- Rotulagem clara de conteúdo gerado por IA.

- Normas técnicas para identificação de IA.

- Marcos legais para tornar isso obrigatório.

- Iniciativas educacionais para melhorar a alfabetização em IA.

"As complexas histórias de Asimov mostraram que até mesmo robôs que tentavam seguir as regras frequentemente descobriam as consequências não intencionais de suas ações. Ainda assim, ter sistemas de IA que tentem seguir as diretrizes éticas de Asimov seria um ótimo começo," concluiu Kozminski.

Artigo: Proposing a 4th law of robotics

Autores: Dariusz Jemielniak

Revista: IEEE Spectrum

Link: https://spectrum.ieee.org/isaac-asimov-robotics

Computação acústica resolve problemas eletronicamente incomputáveis

Transistores são reinventados para hardware de IA

Por que você não deve usar sua bateria até o final da carga

Hologramas 3D podem ser agarrados e manipulados com as mãos

Depósito gigantesco de hidrogênio descoberto na França é renovável

Dois computadores de luz aproximam-se do lançamento comercial

Lançado um "linux" para computadores quânticos

Painéis solares poderão ser fabricados na Lua fundindo solo lunar

Descoberta uma exceção às leis da termodinâmica

Espaço formado por "átomos de espaço" unifica mecânica quântica e relatividade

Dois computadores de luz aproximam-se do lançamento comercial

Criados componentes que superam "esquecimento catastrófico" da IA

Transistores são reinventados para hardware de IA

Chip 3D integra fotônica e eletrônica para IA energeticamente eficiente

Pequenos robôs viram células de materiais inteligentes que imitam a vida

Vem aí o computador que imita os olhos humanos

Todos os direitos reservados.

É proibida a reprodução total ou parcial, por qualquer meio, sem prévia autorização por escrito.